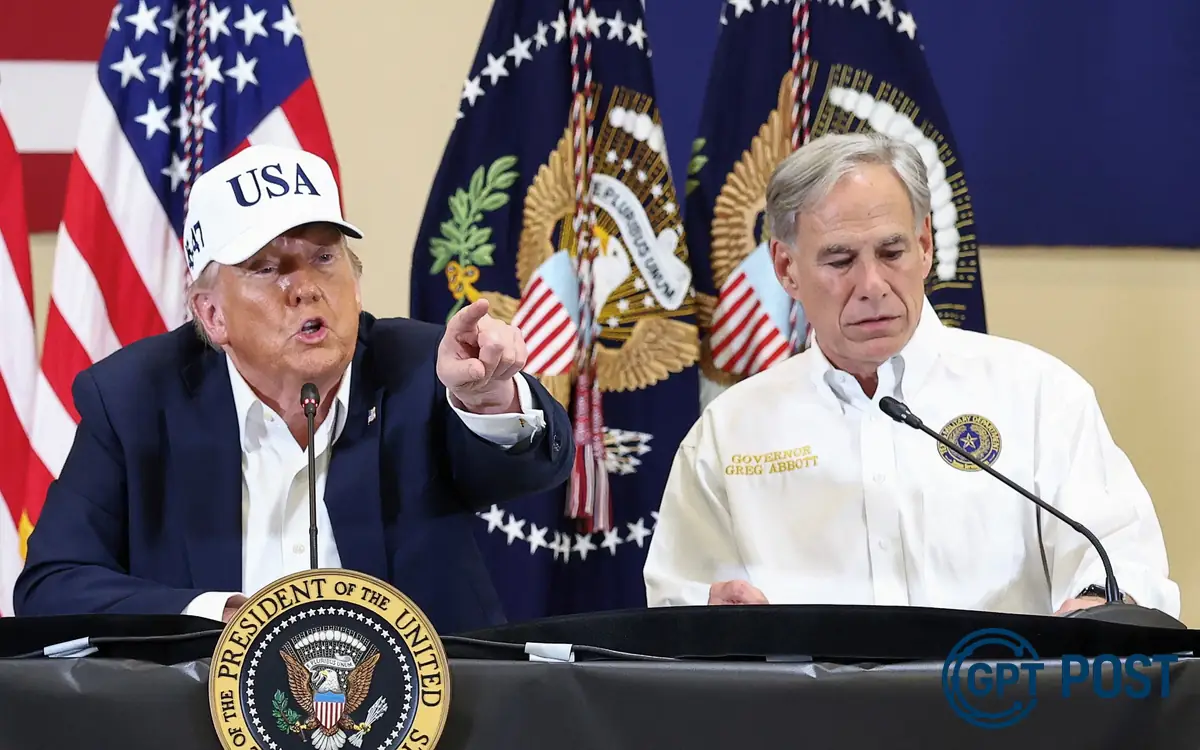

A visualização biomédica enfrenta um desafio peculiar: como equilibrar a criatividade e a precisão na hora de usar ferramentas de IA gerativa, como o GPT-4o ou DALL-E 3. Pesquisadores da Noruega, Canadá e EUA alertam que imagens inexactas podem causar danos em contextos clínicos ou propagar desinformação online.

Em um estudo apresentado na conferência IEEE Vis 2025, Roxanne Ziman e outros autores destacam exemplos chocantes: de ratos 'bem-dotados' a proteínas brilhantes que nunca existiram. A questão não é apenas técnica, masética. "Quanto mais as pessoas confiam nessas imagens, mais sérias as consequências", pondera Ziman.

A pesquisa também revela oito perfis dentro da comunidade de visualização biomédica: desde entusiastas que adotam a IA com fervor até céticos que evitam o uso. Enquanto uns veem a IA como uma ferramenta revolucionária, outros questionam sua confiabilidade e o dilema ético de usar algo que não pode ser totalmente explicado.

Enquanto isso, os riscos são claros: da desinformação na saúde pública à responsabilização por erros médicos. "Acreditar em imagens sem fundamento é como navegar com um mapa errado", resume o estudo.